首先要注意,这些技术本身的普及是难以阻挡的趋势。且本站也看到一些未经修整的音频直接转的MIDI(主要集中在纯钢的作品 所以接下来重点先讲这个)所以这是一个不得不面对的问题。(关于社区,和直接传这种粗糙的MIDI行为的思考放在最后。)

我在想,是否能更进一步让机器处理大头,而人处理细节?

先来明确任务:

输入一个粗糙的,程序转的MIDI(钢琴单轨) (只考虑原本就是纯钢的或者近似的那些音频转的MIDI)

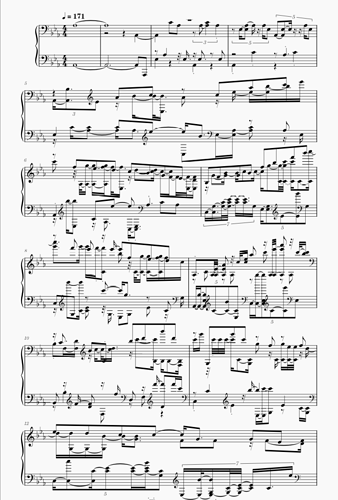

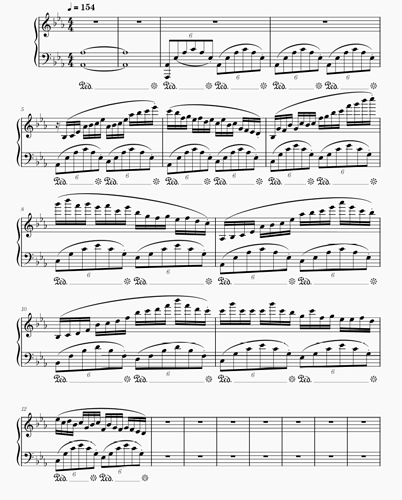

输出一个可以被曲谱软件读取,并且以“人能读”的谱面显示,同时尽可能保留原汁原味的MIDI

尽管大体看上去像是那么一回事,不过这其实还是不明确有很多的主观成分在里面:

比如什么叫程序转的?到底是那些程序?那些技术?什么是原汁原味?等等

我目前的思路是先从PianoTrans的输出入手,且聚焦在输出后的midi而非直接分析PianoTrans内部的过程。大概分为三个任务

-

事件的时长重写(因为PianoTrans对所有的踏板都会进行一种非常奇怪的操作导致踏板触发的那部分事件的结束时间普遍延后到该踏板结束)

-

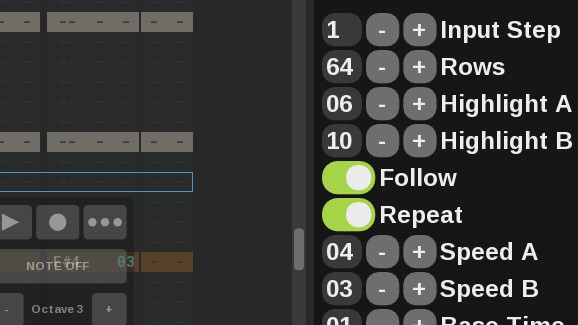

事件的时间对齐(让MIDI能被曲谱软件以正确的方式读取,这并不是说曲谱软件不能读MIDI,而是让那些事件恰好能塞进曲谱里面 而不是做出很多匪夷所思的内容)

-

事件的修补(比如不应该有的音,和缺失的音。但这部分困难的多,可能凭借乐理知识写出的程序流程并不总能完成任务 ,但希望能尽可能减轻人的负担 ,但又不给人增添负担 比如做出一些很蠢的操作)

目前我做了1的一部分,让这种midi辅助人来完成扒谱的程度是达到了。

另外附上一些机器转的midi的材料

liszt-叹息.mid (18.4 KB)

Daniil Trifonov - Grandes Études de Paganini, S_ 141 - VI_ No_ 6 in A Minor .mid (30.1 KB)

Carl Doy - Autumn Leaves (Album Version) .mid (6.3 KB)

两首阿拉伯风格曲,L.66第一首-生动的行板.mid (18.2 KB)

这里是TutorialsByHugo的视频转的

残酷天使的行动纲领.mid (1.3 KB)

站内相同主题手工版midi

(这里的只有前面一段)

Factory NoiseAG - ヴォヤージュ1970.mid (10.4 KB)

这个下面有对应的谱

最后是关于社区,以及直接传这种音频转的(机扒?)MIDI,我的思考是

1.目前技术上看,这种音频转MIDI未达到人做的水平。灌水这种内容会降低平均质量

2.在1仍然成立的情况下,我们应该去主动利用社区的相关机制来抵制这种低质量作品,且自己不去发布那种未经修整的低质量作品,(但使用这类工具辅助扒谱是可行的)

3.不可否认的是,技术本身不断进步的趋势(可能也会不断普及),所以需要以变化的观点去看这件事。作为工具,在确认其确实有用的情况下去使用,而不依赖工具。(这里仅仅就钢琴扒谱来说,依赖程序工具,而非锻炼自己的听力对长期发展来说是有害的)

4.社区的和谐与稳定是建立在大家在一些观点上相互尊重,在核心观点上一致认同的前提上。